Quem programa a culpa? Ética e responsabilidade na Inteligência Artificial

Nessa altura do campeonato, já está claro: a criação de inteligências artificiais levanta um sem-fim de preocupações éticas desde o estágio inicial de seu desenvolvimento. As decisões dos criadores e engenheiros — tão humanos quanto qualquer um de nós — desempenham papel crucial na definição dos valores que essas máquinas incorporam. Surge, então, um cenário ético complexo ao, primeiro, escolher os princípios que nortearão o comportamento da IA e, segundo, ao tentar entender como essas escolhas impactam a sociedade. Apesar de parecer um tanto alarmista, a verdade é que essas pessoas detêm as rédeas de boa parte do futuro e do presente do que entendemos como sociedade.

O livro Ética na Inteligência Artificial de Mark Coeckelbergh, lançado no Brasil pela Editora Ubu, proporciona uma análise abrangente dos novos desafios decorrentes desses avanços que já não parecem mais escolhas e sim inevitabilidades. Antes mesmo da ascensão de modelos gerativos como o chatGPT, Coeckelbergh se dedicava ao estudo das implicações éticas relacionadas ao desenvolvimento de IA e, portanto, é alguém que tem o que dizer. Seu livro de agora visa conscientizar o leitor sobre as inovações incorporadas de forma invisível em tecnologias do cotidiano, além de levantar questões importantes sobre a vida prática da tal ética, abordando preocupações sobre responsabilidade, privacidade e viés. A obra abrange desde narrativas influentes sobre o futuro da IA até questões filosóficas sobre a natureza humana. Sendo bastante acessível, é um acerto.

A reflexão ética proposta por Coeckelbergh transcende as ações e capacidades da IA, mergulhando nas implicações morais que existem a partir do momento mais incipiente de sua criação. As tomadas de decisão dos criadores, programadores e engenheiros no desenvolvimento das tecnologias inteligentes é o que determina os valores incorporados nas máquinas, sendo que a transparência no desenvolvimento de algoritmos e sistemas é uma peça-chave na abordagem ética. Se assegurar a responsabilidade e a confiança na utilização dessas tecnologias for, de fato, um objetivo, a compreensão clara dos critérios de treinamento, fontes de dados e processos de tomada de decisões é o passo inicial. O sigilo excessivo em torno dos modelos de IA, como aponta o autor, naturalmente cria uma barreira de distanciamento para lá de perigosa, pois os usuários raramente estão cientes das bases sobre as quais as decisões automatizadas são tomadas. A compreensão clara dos critérios de treinamento, fontes de dados e processos de tomada de decisões anda de mãos dadas com a missão de responsabilidade e de confiança dessas tecnologias.

E há camadas sobre as quais nem todo mundo pensa. Quem é responsável por ações prejudiciais ou decisões equivocadas tomadas por uma IA? Se um carro que não usa motorista humano tiver que fazer uma escolha rápida no trânsito e isso resultar em algum acidente, quem se culpabiliza? Como atribuir responsabilidade em situações em que a autonomia da máquina desempenha um papel significativo? Esses dilemas exigem abordagens claras e sistemas de responsabilização para garantir que a IA seja utilizada de maneira ética e justa.

A necessidade de abordar questões como essas é incontestável, até mesmo pelo maior dos entusiastas, e diversas iniciativas buscam integrar princípios éticos na formulação de políticas para esse campo. A busca por diretrizes éticas robustas na interação com a inteligência artificial é fundamental para garantir que o progresso tecnológico esteja alinhado com os valores humanos e que as IAs contribuam positivamente para o avanço da sociedade. O diálogo contínuo e a colaboração entre comunidades éticas, desenvolvedores e usuários pode fazer a diferença nos moldes de futuro que estão se formando.

Entretanto, a complexidade do cenário demanda uma cuidadosa reflexão sobre quais ações devem ser tomadas e como orientar essas políticas. Ética na Inteligência Artificial nos diz que, se analisarmos várias propostas e iniciativas, será possível notar que: muitos documentos começam justificando a necessidade de políticas éticas para a IA, articulando princípios que servirão como base para recomendações específicas; esses princípios, frequentemente, derivam de códigos éticos profissionais e princípios éticos gerais; e diversas propostas rejeitam a ideia de uma IA superinteligente que assumiria o controle, concentrando-se em questões mais imediatas, como viés algorítmico e falta de compreensão dos desenvolvedores sobre seus próprios sistemas.

Governos, como o dos Estados Unidos, enfatizam a autorregulação da IA, com intervenção governamental focada na monitorização da segurança e justiça das aplicações. Na Europa, muitos países incorporam a ética na IA em suas estratégias, destacando a importância da “IA explicável” para garantir a transparência e o direito à explicação, com uma abordagem centrada no ser humano. Princípios comuns, como transparência, responsabilidade, justiça e explicabilidade, são destacados em várias propostas, apesar das nuances culturais e abordagens específicas de cada região ou setor. Essa convergência destaca a grande questão global que justifica a leitura de Ética na Inteligência Artificial: é necessário domar o que estamos criando antes que seja tarde.

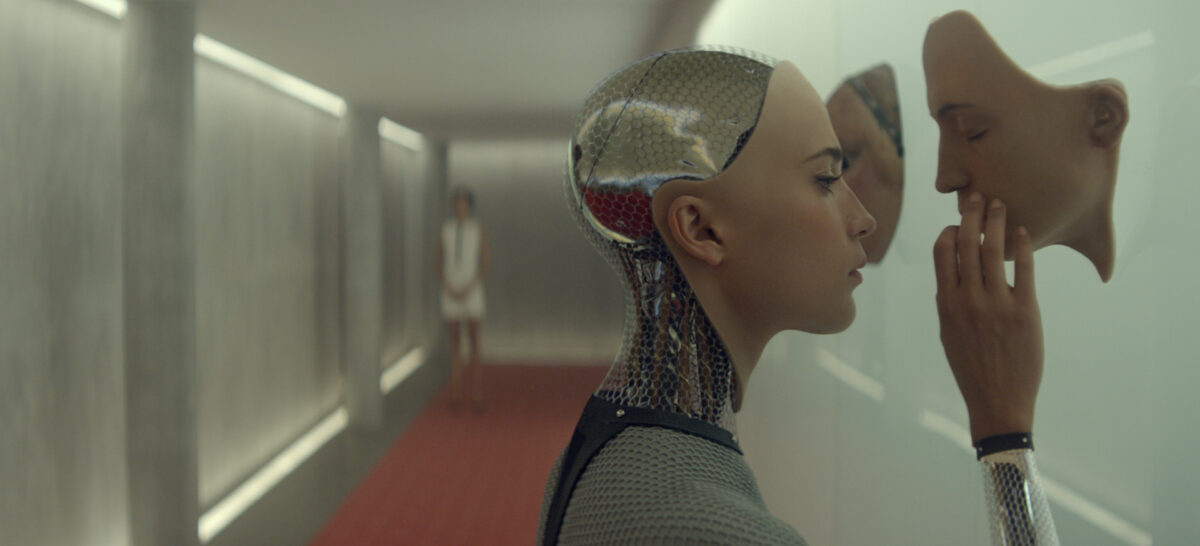

Coeckelbergh destaca outro ponto que parece ignorada, talvez por soar como um filme de ficção científica (Spielberg que o diga). Como lidar com uma inteligência capaz de sentir? Como tratá-la, vamos dizer, de maneira humana?

A controvérsia em torno da suscetibilidade moral na inteligência artificial desencadeia uma reflexão profunda sobre nosso relacionamento com entidades artificiais. Ao imaginarmos uma IA superinteligente, surgem questionamentos sobre a moralidade de desligá-la, e até mesmo sobre a aceitabilidade de interações mais próximas. Pesquisas mostraram que, já nos dias atuais, pessoas criam empatia por robôs e hesitam em causar mal a eles. O caso real do cão-robô Spot, que foi lançado por seus desenvolvedores para testar justamente a empatia das pessoas perante à inteligência artificial, mostra respostas surpreendentemente empáticas. Ou seja, seres humanos não exigem muito de agentes artificiais e logo projetam sobre eles traços de pessoalidade ou humanidade. O exemplo do cão-robô Spot destaca a crescente necessidade de considerar a ética nas interações com entidades artificiais que podem se tornar parte integrante do nosso cotidiano.

A complexidade emerge quando confrontamos a ideia de responsabilidade moral em relação às IAs. A abordagem convencional, considerando as IAs como meras máquinas sem propriedades similares às humanas, é desafiada pela crescente intuição e experiência moral que nos leva a hesitar em maltratar uma IA. Diante disso, diferentes perspectivas éticas são apresentadas, desde a posição mais intuitiva que vê as IAs como ferramentas sem obrigações morais, até argumentos baseados na ética da virtude ou dever indireto. A controvérsia se intensifica quando se explora como as relações sociais, linguagem e cultura humana desempenham um papel na atribuição de status moral às IAs. A ideia de que esse status dependerá de como estão inseridas em nossa vida social sugere que, assim como tratamos animais de estimação, a moralidade em relação às IAs pode ser moldada pela interação humana, contexto e cultura.

Essa controvérsia não apenas instiga a ponderar sobre o status moral das IAs, mas também a repensar nosso papel enquanto juízes morais em um mundo cada vez mais permeado por tecnologias inteligentes. A intrincada trama ética que envolve a inteligência artificial torna evidente que a responsabilidade humana na concepção dessas tecnologias desempenha um papel determinante na definição dos valores incorporados por essas máquinas. Mark Coeckelbergh oferece uma análise perspicaz e para-todos dos desafios. Seu trabalho ressoa com ponderação e esclarecimento, o que é louvável considerando o terreno incerto sobre o qual pisa.

O desafio é abraçar divergências para, em conjunto, fazer com que as inteligências artificiais alcancem todo o potencial benéfico que têm. Mas a jornada ainda é longa e pode seguir em qualquer direção.

Assine: IMPRESSO + DIGITAL

São 04 edições impressas por ano, além de ter acesso exclusivo ao conteúdo digital do nosso site.

Assine a revista